다른 사람의 편지를 대신 써 주는 대필 작가 테오도르는 아내와 별거 중이다. 타인의 마음을 전해주는 일을 하고 있지만, 정작 테오도르 자신은 외롭고 공허하기만 하다. 그러다 어느 날 스스로 생각하고 느끼는 인공지능(AI) 운영체제 ‘사만다’와 만나게 된다. 자기 말에 귀 기울여주고 이해해 주는 사만다에게 테오도르는 사랑을 느끼기 시작한다. 2013년 개봉한 영화 ‘허(Her)’의 내용이다.

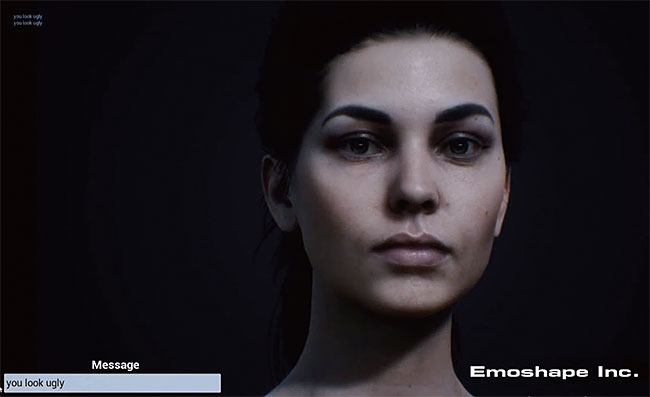

인간의 감정을 읽는 AI 개발 벤처 기업 이모셰이프(EmoShape)의 창업자 겸 최고경영자(CEO) 패트릭 레비-로젠탈은 4월 27일 ‘이코노미조선’과 서면 인터뷰에서 “감정과 지각이 있는 AI와 인간이 교류하는 것은 더 이상 먼 미래의 일이 아니다”라고 말했다. 그는 인스타그램·스냅챗 등에 자주 사용되는 시각 효과 필터(filter)를 개발한 개발자 출신으로, 2009년 영국에서 이모셰이프를 설립했다. 이모셰이프의 혁신적인 기술은 ‘와이어드’ ‘포브스’ 등 여러 언론에 소개된 바 있다. 다음은 레비-로젠탈과 일문일답.

이모셰이프의 AI는 어떻게 인간의 감정을 읽고, 인간과 교류할 수 있나.“우리의 혁신적인 알고리즘은 분노·공포·슬픔·무관심·후회 등 인간..

이코노미조선 멤버십 기사입니다

커버스토리를 제외한 모든 이코노미조선 기사는

발행일자 기준 차주 월요일 낮 12시에

무료로 공개됩니다.

발행일자 기준 차주 월요일 낮 12시에

무료로 공개됩니다.

멤버십 회원이신가요? 로그인