“갓 태어난 아기가 글자를 배우기 전에는 시각과 청각을 통해 주변을 파악합니다. 언어가 아닌 시각으로 세상을 이해하는 인공지능(AI)을 만들고 싶었습니다.”

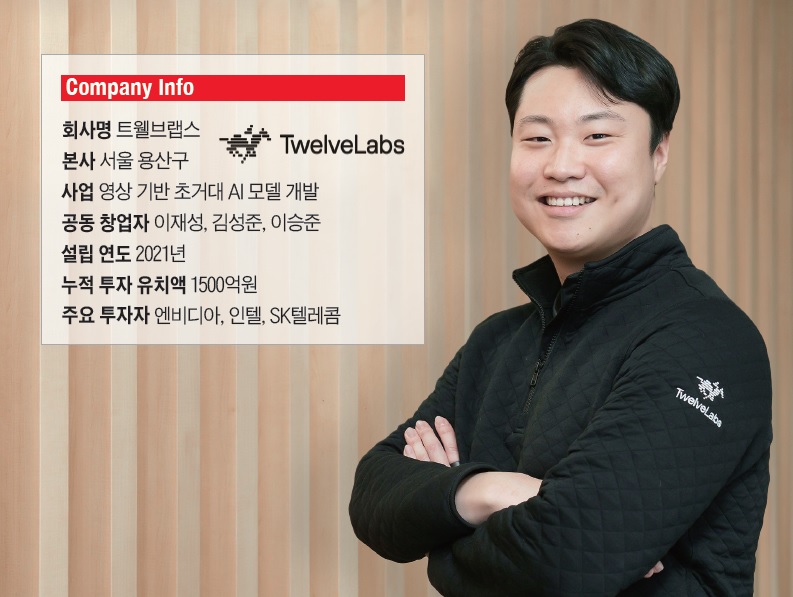

트웰브랩스(TwelveLabs)는 2021년 멀티모달 AI에 매료된 청년 세 명이 창업한 AI 스타트업이다. 멀티모달 AI란 텍스트 중심의 AI 모델과 달리 사진·그림·영상 등 다양한 정보를 토대로 이해하는 AI 모델을 의미한다.

이재성(31) 대표는 미국 캘리포니아대 버클리캠퍼스(UC 버클리)에서 컴퓨터과학을 전공한 뒤 삼성전자·아마존 등에서 인턴을 마치고 국방의무를 위해 2019년 국방부 사이버작전사령부에 자원했다. 군 복무 시절 트웰브랩스 공동 창업자인 김성준 개발총괄이사와 이승준 기술총괄이사를 만났다.

당시 AI 산업에서는 언어 기반 모델이 주류였지만, 이들은 인간 인식 구조처럼 시각적 데이터를 기반으로 맥락을 이해하는 AI가 미래를 바꿀 것이라고 봤다. 청년 세 명은 군 복무를 하면서 모은 월급 200만원으로 법인을 세웠고, 이후 미국 액셀러레이터 테크스타스(Techstars)의 눈에 띄면서 본격적인 기술 개발에 착수했다. 창업 초기 구성원은 총 12명으로, 트웰브랩스라는 사명도 여기서 유래했다. 현재는 한국에 연구개발(R&D) 인력 40명, 미국에 비즈니스 마케팅 담당 인력 40명이 근무하고 있다.

트웰브랩스의 대표 제품은 영상 검색 모델 ‘마렝고(Marengo)’와 영상 요약 및 질의응답 모델 ‘페가수스(Pegasus)’다. 마렝고는 수십, 수백 시간 분량의 영상 데이터 중 원하는 장면을 텍스트나 이미지로 빠르게 검색할 수 있는 모델로, 미디어·스포츠·공공기관 등에서 활용하고 있다. 페가수스는 영상 내용을 분석해 요약하거나 특정 질문에 답하는 모델로, 뉴스·광고·의료 등의 산업에 적용할 수 있다.

트웰브랩스는 최근 아마존웹서비스(AWS)의 생성 AI 개발 및 배포 플랫폼인 ‘베드록(Bedrock)’에 국내 기업 최초로 모델을 탑재하며 주목받았다. 최근 서울 용산구 사무실에서 만난 이재성 대표는 이번 계약으로 전 세계 수십만 기업이 트웰브랩스 모델을 직접 사용할 수 있게 됐다고 설명했다. 예컨대 캐나다 스포츠 엔터테인먼트 기업 ‘메이플리프 스포츠’는 마렝고를 도입해 경기 하이라이트 영상 자동 생성 시스템을 구축하고 있다.

트웰브랩스는 엔비디아와 인텔, SK텔레콤 등으로부터 1500억원의 누적 투자금을 유치했다. 이 대표는 “북미 시장에서 대형 고객사가 트웰브랩스를 활용하고 있고, 유럽과 아시아 시장도 베드록을 발판으로 빠르게 공략할 계획”이라고 말했다. 다음은 일문일답.

용산구에 본사를 둔 스타트업이라니 독특하다. 위치 선정 배경이 궁금하다.

“스타트업이 많이 몰린 지역에 있으면 본업에 충실하기가 힘들 것 같았다. 공동 창업자가 서로 처음 만난 곳이 용산구였다. 국방부 산하 사이버작전사령부에서 군 복무하면서 만난 인연인데, 당시 차례로 전역했고, 사회에 나와 같이 일하기로 한 추억이 있다.”

자본금이 200만원에 불과했다. 그걸로 뭘 할 수 있었나.

“공동 창업자 세 명이 갖고 있던 돈이 200만원 정도였다. 하지만 간절한 마음으로 임하면 200만원으로도 많은 것을 할 수 있다. 사무실이 없어 지인이 운영하는 회사 사무실을 빌려서 일했다. 카페에서도 일했고, 정부에서 지원해 주는 창업 센터도 찾았다. 2021년 3월 창업했는데, 당시 코로나19 팬데믹(pandemic·감염병 대유행)이 한창이었다. 파트너와 일할 때는 미국 시각에 맞춰 새벽에 화상회의를 했고 한국 시각에는 발로 뛰었다. 1년쯤 그렇게 일하고 투자받은 뒤 조금씩 사업을 확장해 갔다.”

‘영상 기반 AI’ 모델은 생소하다.

“대표적으로 미디어 분야에 활발하게 활용된다. 디즈니를 예로 들면, 2시간짜리 영화를 만들기 위해 수만 시간의 영상을 찍는다. 영화를 편집하려면 사람이 일일이 자료를 다 찾아봐야 한다. 트웰브랩스 모델은 몇만 시간 분량의 영상을 다 읽은 다음, 검색만으로 원하는 장면을 찾을 수 있다. 공공 분야에서는 CCTV 영상 탐지, 모빌리티 분야에서는 자율주행 관련 영상 분석에도 사용할 수 있다. 헬스케어 분야에 적용될 날도 머지않았다. 예컨대 고령화시대에 부모님이 잘 계신지 확인해 주는 로봇에 우리 기술을 탑재할 수 있다. 이상 반응에 대한 정보를 습득한 모델이 실시간으로 영상을 탐지하고 상황을 파악해 병원이나 가족에게 전달하는 것이다.”

AWS 베드록에 한국 기업 최초로 AI 모델이 탑재돼 주목받았다.

“우리 제품이 베드록에 올라간 것에 관해 설명하자면, 지난해 말부터 논의를 이어 왔다. AWS 고객이 방대한 영상 자료를 클라우드에 올려놓고 활용하지 못하는 경우가 많다고 한다. AWS 측에 트웰브랩스 제품을 넣어달라는 고객사 요청도 다수 있었다고 안다. 우리 모델이 베드록에 탑재되면서 데이터 보안 측면이나 AWS에 대한 고객사 신뢰도가 우리 회사 글로벌 인지도를 높이는 데 긍정적으로 작용할 것으로 기대한다.”

AWS와 인연도 궁금하다.

“창업 초창기부터 AWS와 인연을 맺었으니, 벌써 4년이 됐다. 자본이 아예 없었을 때는 AWS가 지원한 컴퓨팅 리소스가 많은 도움이 됐다. 지금은 모델 하나 만드는 데 수천억원이 드는 시대지만, 창업 초기에는 모델을 학습시키는 데 1억원을 쓴다는 것도 생소할 때였다. AWS가 빠르게 이 흐름을 읽었고, 우리를 지원해 줬다.”

오픈AI나 구글도 멀티모달 AI를 만든다. 트웰브랩스만의 차별점은.

“우리는 단순한 ‘모델’ 회사가 아니다. 영상 처리(프로세싱)부터 영상 변환(인덱싱) 기술까지 다 만든다. 언어로 모델을 학습시키는 게 아니고, 영상 자체로 모델을 학습시키니 AI가 정보가 전개되는 흐름을 잘 인식한다. 영상 정보가 바탕이 되다 보니, 이미지·오디오 심지어 음악까지 학습한다. 타사 모델 대비 빠르고, 적은 비용으로 작업할 수 있다. 최신 제품인 페가수스-1.2는 경쟁 제품인 GPT-4o와 구글 제미나이 1.5프로보다 응답 속도가 빨랐다.”

트웰브랩스가 그리는 영상 AI의 미래는 어떤 모습인가.

“지금까지는 생성된 영상을 다루는 제품을 내놓았다. 앞으로는 실시간으로 생성되는 영상을 빠르게 이해하는 제품을 만들고 싶다. 실시간 스트리밍 서비스 등에 영상을 제공할 정도로 기술이 고도화하고 있다. 궁극적으로는 카메라가 달린 모든 장비에 트웰브랩스 모델이 탑재돼 실시간으로 정보가 축약된 메시지를 보내거나, 필요한 작업과 연결하는 것이 가능할 것이다.”

한국 AI 산업의 발전을 위한 조언 부탁한다.

“언어 모델을 만드는 게 전부는 아니다. ‘늦었으니 따라가자’라는 사고를 버렸으면 좋겠다. 다음 흐름이 뭔지 예측하고 먼저 가야 오히려 앞설 수 있다고 생각한다. 한국에서 정말 좋은 AI 모델이 나오길 바란다. 한국 기반 모델을 글로벌 고객이 활용하면서 나오는 노하우나 지식이 한국 AI 산업에 퍼져야 한다. 그런 지식에 목마른 인재가 미국으로 가는 것이다. 앞으로 정부가 한국 AI 주권에 이바지하는 스타트업, 대기업의 목소리에 귀를 많이 기울여 주면 좋겠다.”